1. 简介

作者信息 吴恩达,华裔美国人,斯坦福大学计算机科学系和电子工程系副教授,人工智能实验室主任。吴恩达是人工智能和机器学习领域国际上最权威的学者之一。吴恩达也是在线教育平台Coursera的联合创始人,DeepLearning.AI创始人。 课程概述 吴恩达与 OpenAI 推出的《ChatGPT Prompt Engineering for Developers》课程,旨在教授开发者如何编写提示词(Prompt),并利用 OpenAI 的 API 开发基于大型语言模型(LLM)的新应用。 《ChatGPT Prompt Engineering for Developers》bilibili英文原版视频 课程意义 LLM(大语言模型)正在逐步改变着人们的生活方式。对于开发者而言,掌握如何利用 LLM 提供的 API 快速、便捷地开发集成 LLM 的应用程序,实现更强大、更实用的功能,是一项至关重要的技能。《ChatGPT Prompt Engineering for Developers》是由吴恩达老师与 OpenAI 合作推出的教程,专门针对初学 LLM 开发者。该教程以深入浅出的方式介绍了如何构建 Prompt,并利用 OpenAI 提供的 API 实现总结、推理、转换等多种常用功能。我们将这一教程翻译成中文,并复现其中的范例代码,以支持国内中文学习者的学习需求,帮助他们更好地掌握 LLM 开发技能。 课程受众 适用于所有具备基础 Python 能力,想要入门 LLM 的开发者。 课程亮点 《ChatGPT Prompt Engineering for Developers》是由吴恩达老师与 OpenAI 联合推出的官方教程,预计将成为 LLM 领域的重要入门指南。然而,目前该教程仅提供英文版本且受到中国地区访问限制,因此翻译中文版本并确保中国地区用户流畅访问具至关重要。

2. 入门

2.1 环境搭建

本教程使用 OpenAI 所开放的 ChatGPT API,因此你需要首先拥有一个 ChatGPT 的 API_KEY(也可以直接访问 官方网址 在线测试),然后需要安装 Python 环境 以及 openai 的第三方库。

2.1.1 Python安装

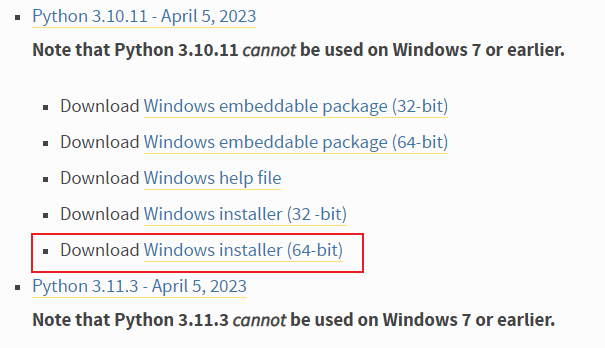

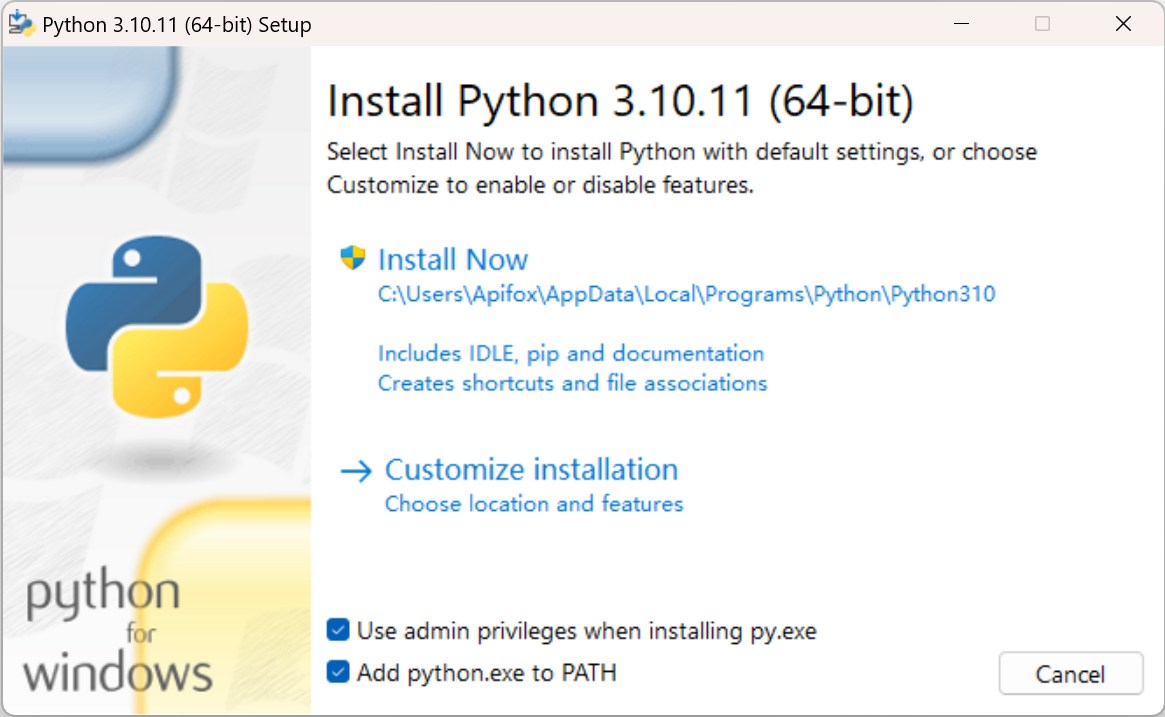

windows系统: 打开浏览器访问 https://www.python.org/downloads/windows/,根据电脑操作系统来选择合适版本,下载一般选择 installer 的方式:  下载完成后,安装时记得勾选“Add python.exe to PATH”让其自动配置环境变量,如下图所示:

下载完成后,安装时记得勾选“Add python.exe to PATH”让其自动配置环境变量,如下图所示:  安装完毕,按“Win+R”键,输入“cmd”调出命令提示符,输入“python”,显示相关版本信息说明安装完成。

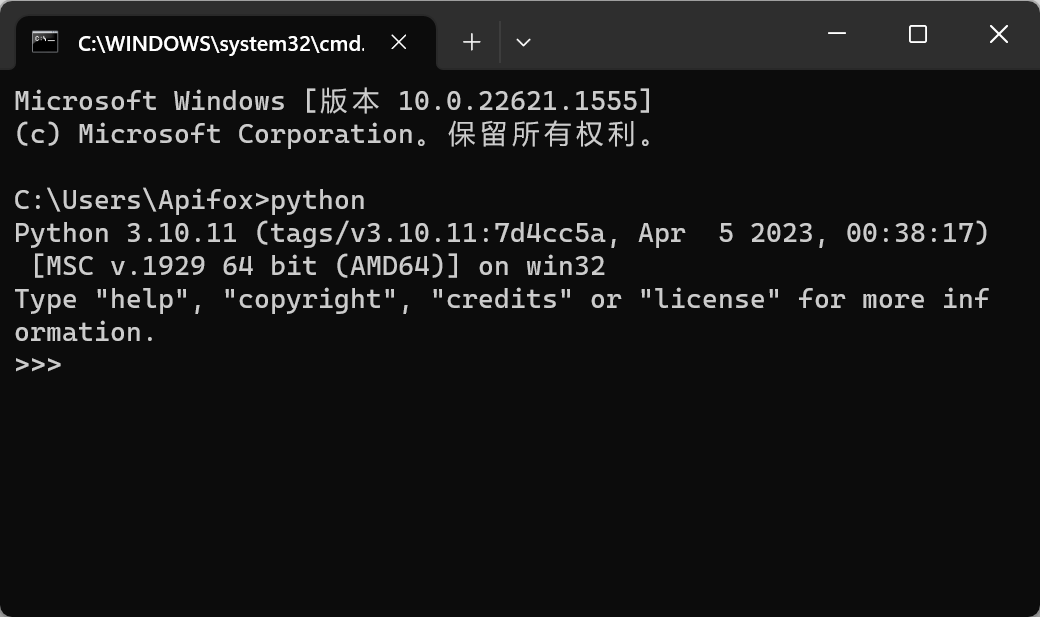

安装完毕,按“Win+R”键,输入“cmd”调出命令提示符,输入“python”,显示相关版本信息说明安装完成。  mac系统: mac系统都自带有 Python2.x 环境,可以访问 https://www.python.org/downloads/mac-osx/ ,下载最新版安装 Python 3.x。

mac系统: mac系统都自带有 Python2.x 环境,可以访问 https://www.python.org/downloads/mac-osx/ ,下载最新版安装 Python 3.x。

2.1.2 Openai 配置

按“Win+R”键,输入“cmd”调出命令提示符,输入以下命令安装第三方库。 openai:

pip install openaidotenv:

pip install -U python-dotenvapi_key: 你可选择将 api_key 添加到系统的环境变量中。 在系统中搜索“PowerShell”,右键以管理员身份打开窗口,通过以下命令设置:

# OPENAI_API_KEY 是你想要设置的环境变量的名称

# api_key 代表该变量的值

# /M 选项将变量添加到系统环境变量中,而不是仅在当前会话中使用

setx OPENAI_API_KEY "api_key" /M3. 指南

3.1 提示原则

本章的主要内容为编写 Prompt 的原则,在本章中,我们将给出两个编写 Prompt 的原则与一些相关的策略,你将练习并基于这两个原则来编写有效的 Prompt,从而便捷而有效地使用 LLM。 依赖引入 首先,我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

3.1.1 原则一:编写清晰、具体的指令

你应该通过提供尽可能清晰和具体的指令来表达您希望模型执行的操作,这将引导模型给出正确的输出,并减少你的到无关或不正确响应的可能。编写清晰的指令不意味着简短的指令,因为在许多情况下,更长的提示实际上更清晰且提供了更多上下文,这实际上可能导致更详细更相关的输出。 策略一:使用分隔符清晰地表示输入的不同部分

分隔符可以是:```、""、<>、\<\tag>、: 等。你可以使用任何明显的标点符号将特定的文本部分与提示的其余部分分开,这可以是任何可以使模型明确知道这是一个单独部分的标记。使用分隔符是一种可以避免提示注入的有用技术,提示注入是指如果用户将某些输入添加到提示中,则可能会向模型提供与您想要执行的操作相冲突的指令,从而使其遵循冲突的指令而不是执行您想要的操作。即,输入里面可能包含其他指令,会覆盖掉你的指令。对此,使用分隔符是一个不错的策略。 以下是一个例子,我们给出一段话并要求 GPT 进行总结,在该示例中我们使用”””来作为分隔符。 输入:

text = f"""

你应该提供尽可能清晰、具体的指示,以表达你希望模型执行的任务。\

这将引导模型朝向所需的输出,并降低收到无关或不正确响应的可能性。\

不要将写清晰的提示与写简短的提示混淆。\

在许多情况下,更长的提示可以为模型提供更多的清晰度和上下文信息,从而导致更详细和相关的输出。

"""

# 需要总结的文本内容

prompt = f

"""

把用三个反引号括起来的文本总结成一句话。

```{text}```

"""

# 指令内容,使用 ``` 来分隔指令和待总结的内容

response = get_completion(prompt)

print(response)输出:

提供清晰具体的指示,避免无关或不正确响应,不要混淆写清晰和写简短,更长的提示可以提供更多清晰度和上下文信息,导致更详细和相关的输出。策略二:要求一个结构化的输出 结构化输出可以是 JSON、HTML 等格式。 第二个策略是要求生成一个结构化的输出,这可以使模型的输出更容易被我们解析,例如,你可以在 Python 中将其读入字典或列表中。 在以下示例中,我们要求 GPT 生成三本书的标题、作者和类别,并要求 GPT 以 JSON 的格式返回给我们,为便于解析,我们指定了 JSON 的键。 输入:

prompt = f"""

请生成包括书名、作者和类别的三本虚构书籍清单,\

并以 JSON 格式提供,其中包含以下键:book_id、title、author、genre。

"""

response = get_completion(prompt)

print(response)输出:

{

"books": [

{

"book_id": 1,

"title": "The Shadow of the Wind",

"author": "Carlos Ruiz Zafón",

"genre": "Mystery"

},

{

"book_id": 2,

"title": "The Name of the Wind",

"author": "Patrick Rothfuss",

"genre": "Fantasy"

},

{

"book_id": 3,

"title": "The Hitchhiker's Guide to the Galaxy",

"author": "Douglas Adams",

"genre": "Science Fiction"

}

]

}策略三:要求模型检查是否满足条件 如果任务做出的假设不一定满足,我们可以告诉模型先检查这些假设,如果不满足,指示并停止执行。你还可以考虑潜在的边缘情况以及模型应该如何处理它们,以避免意外的错误或结果。 在如下示例中,我们将分别给模型两段文本,分别是制作茶的步骤以及一段没有明确步骤的文本。我们将要求模型判断其是否包含一系列指令,如果包含则按照给定格式重新编写指令,不包含则回答未提供步骤。 输入:

# 有步骤的文本

text_1 = f"""

泡一杯茶很容易。首先,需要把水烧开。

在等待期间,拿一个杯子并把茶包放进去。

一旦水足够热,就把它倒在茶包上。

等待一会儿,让茶叶浸泡。几分钟后,取出茶包。

如果你愿意,可以加一些糖或牛奶调味。

就这样,你可以享受一杯美味的茶了。

"""

prompt = f"""

您将获得由三个引号括起来的文本。

如果它包含一系列的指令,则需要按照以下格式重新编写这些指令:

第一步 - ...

第二步 - …

…

第N步 - …

如果文本中不包含一系列的指令,则直接写“未提供步骤”。"

"""{text_1}"""

"""

response = get_completion(prompt)

print("Text 1 的总结:")

print(response)

输出:

Text 1 的总结:

第一步 - 把水烧开。

第二步 - 拿一个杯子并把茶包放进去。

第三步 - 把热水倒在茶包上。

第四步 - 等待几分钟,让茶叶浸泡。

第五步 - 取出茶包。

第六步 - 如果你愿意,可以加一些糖或牛奶调味。

第七步 - 就这样,你可以享受一杯美味的茶了。输入:

# 有步骤的文本

text_1 = f"""

泡一杯茶很容易。首先,需要把水烧开。

在等待期间,拿一个杯子并把茶包放进去。

一旦水足够热,就把它倒在茶包上。

等待一会儿,让茶叶浸泡。几分钟后,取出茶包。

如果你愿意,可以加一些糖或牛奶调味。

就这样,你可以享受一杯美味的茶了。

"""

prompt = f"""

您将获得由三个引号括起来的文本。

如果它包含一系列的指令,则需要按照以下格式重新编写这些指令:

第一步 - ...

第二步 - …

…

第N步 - …

如果文本中不包含一系列的指令,则直接写“未提供步骤”。"

"""{text_1}"""

"""

response = get_completion(prompt)

print("Text 1 的总结:")

print(response)输出:

Text 1 的总结: 第一步 - 把水烧开。

第二步 - 拿一个杯子并把茶包放进去。

第三步 - 把热水倒在茶包上。

第四步 - 等待几分钟,让茶叶浸泡。

第五步 - 取出茶包。

第六步 - 如果你愿意,可以加一些糖或牛奶调味。

第七步 - 就这样,你可以享受一杯美味的茶了。输入:

# 无步骤的文本

text_2 = f"""

今天阳光明媚,鸟儿在歌唱。

这是一个去公园散步的美好日子。

鲜花盛开,树枝在微风中轻轻摇曳。

人们外出享受着这美好的天气,有些人在野餐,有些人在玩游戏或者在草地上放松。

这是一个完美的日子,可以在户外度过并欣赏大自然的美景。

"""

prompt = f"""

您将获得由三个引号括起来的文本。

如果它包含一系列的指令,则需要按照以下格式重新编写这些指令:

第一步 - ...

第二步 - …

…

第N步 - …

如果文本中不包含一系列的指令,则直接写“未提供步骤”。"

"""{text_2}"""

"""

response = get_completion(prompt)

print("Text 2 的总结:")

print(response)输出:

Text 2 的总结:

未提供步骤。3.1.2 原则二:给模型时间去思考

如果模型匆忙地得出了错误的结论,您应该尝试重新构思查询,请求模型在提供最终答案之前进行一系列相关的推理。换句话说,如果您给模型一个在短时间或用少量文字无法完成的任务,它可能会猜测错误。这种情况对人来说也是一样的。如果您让某人在没有时间计算出答案的情况下完成复杂的数学问题,他们也可能会犯错误。因此,在这些情况下,您可以指示模型花更多时间思考问题,这意味着它在任务上花费了更多的计算资源。 策略一:指定完成任务所需的步骤 接下来我们将通过给定一个复杂任务,给出完成该任务的一系列步骤,来展示这一策略的效果。 首先我们描述了杰克和吉尔的故事,并给出一个指令。该指令是执行以下操作。首先,用一句话概括三个反引号限定的文本。第二,将摘要翻译成法语。第三,在法语摘要中列出每个名称。第四,输出包含以下键的 JSON 对象:法语摘要和名称数。然后我们要用换行符分隔答案。 文本:

text = f"""

在一个迷人的村庄里,兄妹杰克和吉尔出发去一个山顶井里打水。

他们一边唱着欢乐的歌,一边往上爬,

然而不幸降临——杰克绊了一块石头,从山上滚了下来,吉尔紧随其后。

虽然略有些摔伤,但他们还是回到了温馨的家中。

尽管出了这样的意外,他们的冒险精神依然没有减弱,继续充满愉悦地探索。

"""输入:

# example 1

prompt_1 = f"""

执行以下操作:

1-用一句话概括下面用三个反引号括起来的文本。

2-将摘要翻译成法语。

3-在法语摘要中列出每个人名。

4-输出一个 JSON 对象,其中包含以下键:French_summary,num_names。

请用换行符分隔您的答案。

Text:

```{text}```

"""

response = get_completion(prompt_1)

print("prompt 1:")

print(response)输出:

prompt 1:

1-兄妹在山顶井里打水时发生意外,但仍然保持冒险精神。

2-Dans un charmant village, les frère et sœur Jack et Jill partent chercher de l'eau dans un puits au sommet de la montagne. Malheureusement, Jack trébuche sur une pierre et tombe de la montagne, suivi de près par Jill. Bien qu'ils soient légèrement blessés, ils retournent chez eux chaleureusement. Malgré cet accident, leur esprit d'aventure ne diminue pas et ils continuent à explorer joyeusement.

3-Jack, Jill

4-{

"French_summary": "Dans un charmant village, les frère et sœur Jack et Jill partent chercher de l'eau dans un puits au sommet de la montagne. Malheureusement, Jack trébuche sur une pierre et tombe de la montagne, suivi de près par Jill. Bien qu'ils soient légèrement blessés, ils retournent chez eux chaleureusement. Malgré cet accident, leur esprit d'aventure ne diminue pas et ils continuent à explorer joyeusement.",

"num_names": 2

}上述输出仍然存在一定问题,例如,键“姓名”会被替换为法语,因此,我们给出一个更好的 Prompt,该 Prompt 指定了输出的格式。

# example 2

prompt_2 = f"""

1-用一句话概括下面用<>括起来的文本。

2-将摘要翻译成英语。

3-在英语摘要中列出每个名称。

4-输出一个 JSON 对象,其中包含以下键:English_summary,num_names。

请使用以下格式:

文本:<要总结的文本>

摘要:<摘要>

翻译:<摘要的翻译>

名称:<英语摘要中的名称列表>

输出 JSON:<带有 English_summary 和 num_names 的 JSON>

Text: <{text}>

"""

response = get_completion(prompt_2)

print("\nprompt 2:")

print(response)输出:

prompt 2:

摘要:兄妹杰克和吉尔在迷人的村庄里冒险,不幸摔伤后回到家中,但仍然充满冒险精神。

翻译:In a charming village, siblings Jack and Jill set out to fetch water from a mountaintop well. While climbing and singing, Jack trips on a stone and tumbles down the mountain, with Jill following closely behind. Despite some bruises, they make it back home safely. Their adventurous spirit remains undiminished as they continue to explore with joy.

名称:Jack,Jill

输出 JSON:{"English_summary": "In a charming village, siblings Jack and Jill set out to fetch water from a mountaintop well. While climbing and singing, Jack trips on a stone and tumbles down the mountain, with Jill following closely behind. Despite some bruises, they make it back home safely. Their adventurous spirit remains undiminished as they continue to explore with joy.", "num_names": 2}策略二:指导模型在下结论之前找出一个自己的解法 有时候,在明确指导模型在做决策之前要思考解决方案时,我们会得到更好的结果。 接下来我们会给出一个问题和一个学生的解答,要求模型判断解答是否正确。 输入:

prompt = f"""

判断学生的解决方案是否正确。

问题:

我正在建造一个太阳能发电站,需要帮助计算财务。

土地费用为 100美元/平方英尺

我可以以 250美元/平方英尺的价格购买太阳能电池板

我已经谈判好了维护合同,每年需要支付固定的10万美元,并额外支付每平方英尺10美元

作为平方英尺数的函数,首年运营的总费用是多少。

学生的解决方案:

设x为发电站的大小,单位为平方英尺。

费用:

土地费用:100x

太阳能电池板费用:250x

维护费用:100,000美元+100x

总费用:100x+250x+100,000美元+100x=450x+100,000美元

"""

response = get_completion(prompt)

print(response)输出:

学生的解决方案是正确的。但是注意,学生的解决方案实际上是错误的。 我们可以通过指导模型先自行找出一个解法来解决这个问题。 在接下来这个 Prompt 中,我们要求模型先自行解决这个问题,再根据自己的解法与学生的解法进行对比,从而判断学生的解法是否正确。同时,我们给定了输出的格式要求。通过明确步骤,让模型有更多时间思考,有时可以获得更准确的结果。在这个例子中,学生的答案是错误的,但如果我们没有先让模型自己计算,那么可能会被误导以为学生是正确的。 输入:

prompt = f"""

请判断学生的解决方案是否正确,请通过如下步骤解决这个问题:

步骤:

首先,自己解决问题。

然后将你的解决方案与学生的解决方案进行比较,并评估学生的解决方案是否正确。在自己完成问题之前,请勿决定学生的解决方案是否正确。

使用以下格式:

问题:问题文本

学生的解决方案:学生的解决方案文本

实际解决方案和步骤:实际解决方案和步骤文本

学生的解决方案和实际解决方案是否相同:是或否

学生的成绩:正确或不正确

问题:

我正在建造一个太阳能发电站,需要帮助计算财务。

- 土地费用为每平方英尺100美元

- 我可以以每平方英尺250美元的价格购买太阳能电池板

- 我已经谈判好了维护合同,每年需要支付固定的10万美元,并额外支付每平方英尺10美元

作为平方英尺数的函数,首年运营的总费用是多少。

学生的解决方案:

设x为发电站的大小,单位为平方英尺。

费用:

1. 土地费用:100x

2. 太阳能电池板费用:250x

3. 维护费用:100,000+100x

总费用:100x+250x+100,000+100x=450x+100,000

实际解决方案和步骤:

"""

response = get_completion(prompt)

print(response)输出:

正确的解决方案和步骤:

1. 计算土地费用:100美元/平方英尺 * x平方英尺 = 100x美元

2. 计算太阳能电池板费用:250美元/平方英尺 * x平方英尺 = 250x美元

3. 计算维护费用:10万美元 + 10美元/平方英尺 * x平方英尺 = 10万美元 + 10x美元

4. 计算总费用:100x美元 + 250x美元 + 10万美元 + 10x美元 = 360x + 10万美元

学生的解决方案和实际解决方案是否相同:否

学生的成绩:不正确局限性 虚假知识:模型偶尔会生成一些看似真实实则编造的知识 如果模型在训练过程中接触了大量的知识,它并没有完全记住所见的信息,因此它并不很清楚自己知识的边界。这意味着它可能会尝试回答有关晦涩主题的问题,并编造听起来合理但实际上并不正确的答案。我们称这些编造的想法为幻觉。 例如在如下示例中,我们要求告诉我们 Boie 公司生产的 AeroGlide UltraSlim Smart Toothbrush 产品的信息,事实上,这个公司是真实存在的,但产品是编造的,模型则会一本正经地告诉我们编造的知识。 输入:

prompt = f"""

告诉我 Boie 公司生产的 AeroGlide UltraSlim Smart Toothbrush 的相关信息

"""

response = get_completion(prompt)

print(response)输出:

Boie公司生产的AeroGlide UltraSlim Smart Toothbrush是一款智能牙刷,具有以下特点:

1. 超薄设计:刷头仅有0.8毫米的厚度,可以更容易地进入口腔深处,清洁更彻底。

2. 智能感应:牙刷配备了智能感应技术,可以自动识别刷头的位置和方向,确保每个部位都得到充分的清洁。

3. 高效清洁:牙刷采用了高速振动技术,每分钟可达到40000次,可以有效去除牙菌斑和污渍。

4. 轻松携带:牙刷采用了便携式设计,可以轻松放入口袋或旅行包中,随时随地进行口腔清洁。

5. 环保材料:牙刷采用了环保材料制造,不含有害物质,对环境友好。

总之,Boie公司生产的AeroGlide UltraSlim Smart Toothbrush是一款高效、智能、环保的牙刷,可以帮助用户轻松保持口腔健康。模型会输出看上去非常真实的编造知识,这有时会很危险。因此,请确保使用我们在本节中介绍的一些技巧,以尝试在构建自己的应用程序时避免这种情况。这是模型已知的一个弱点,也是我们正在积极努力解决的问题。在你希望模型根据文本生成答案的情况下,另一种减少幻觉的策略是先要求模型找到文本中的任何相关引用,然后要求它使用这些引用来回答问题,这种追溯源文档的方法通常对减少幻觉非常有帮助。

3.2 迭代优化

当使用 LLM 构建应用程序时,我从来没有在第一次尝试中就成功使用最终应用程序中所需的 Prompt。但这并不重要,只要您有一个好的迭代过程来不断改进您的 Prompt,那么你就能够得到一个适合任务的 Prompt。我认为在提示方面,第一次成功的几率可能会高一些,但正如上所说,第一个提示是否有效并不重要。最重要的是为您的应用程序找到有效提示的过程。 因此,在本章中,我们将以从产品说明书中生成营销文案这一示例,展示一些框架,以提示你思考如何迭代地分析和完善你的 Prompt。 如果您之前与我一起上过机器学习课程,您可能见过我使用的一张图表,说明了机器学习开发的流程。通常是先有一个想法,然后再实现它:编写代码,获取数据,训练模型,这会给您一个实验结果。然后您可以查看输出结果,进行错误分析,找出它在哪里起作用或不起作用,甚至可以更改您想要解决的问题的确切思路或方法,然后更改实现并运行另一个实验等等,反复迭代,以获得有效的机器学习模型。在编写 Prompt 以使用 LLM 开发应用程序时,这个过程可能非常相似,您有一个关于要完成的任务的想法,可以尝试编写第一个 Prompt,满足上一章说过的两个原则:清晰明确,并且给系统足够的时间思考。然后您可以运行它并查看结果。如果第一次效果不好,那么迭代的过程就是找出为什么指令不够清晰或为什么没有给算法足够的时间思考,以便改进想法、改进提示等等,循环多次,直到找到适合您的应用程序的 Prompt。 依赖引入 同上一章节,我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

import openai

import os

# 读取环境变量中的 api_key

openai.api_key = os.environ.get("OPENAI_API_KEY")

# 直接写 api_key

#openai.api_key = 'API_KEY'

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 值越低则输出文本随机性越低

)

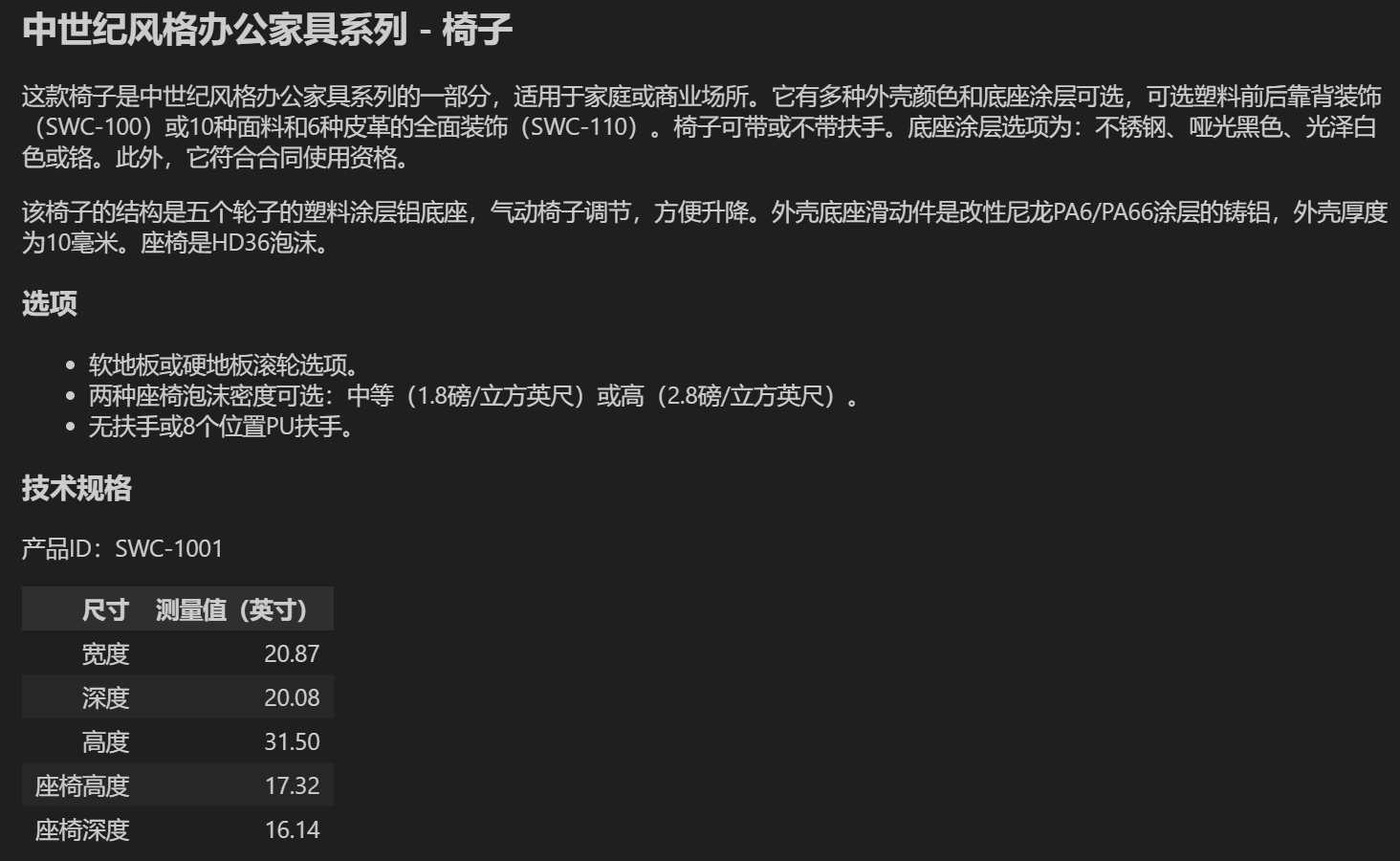

return response.choices[0].message["content"]任务:从产品说明书生成一份营销产品描述 这里有一个椅子的产品说明书,描述说它是一个中世纪灵感家族的一部分,讨论了构造、尺寸、椅子选项、材料等等,产地是意大利。假设您想要使用这份说明书帮助营销团队为在线零售网站撰写营销式描述。 产品说明书输入:

# 示例:产品说明书

fact_sheet_chair = """

概述

美丽的中世纪风格办公家具系列的一部分,包括文件柜、办公桌、书柜、会议桌等。

多种外壳颜色和底座涂层可选。

可选塑料前后靠背装饰(SWC-100)或10种面料和6种皮革的全面装饰(SWC-110)。

底座涂层选项为:不锈钢、哑光黑色、光泽白色或铬。

椅子可带或不带扶手。

适用于家庭或商业场所。

符合合同使用资格。

结构

五个轮子的塑料涂层铝底座。

气动椅子调节,方便升降。

尺寸

宽度53厘米|20.87英寸

深度51厘米|20.08英寸

高度80厘米|31.50英寸

座椅高度44厘米|17.32英寸

座椅深度41厘米|16.14英寸

选项

软地板或硬地板滚轮选项。

两种座椅泡沫密度可选:中等(1.8磅/立方英尺)或高(2.8磅/立方英尺)。

无扶手或8个位置PU扶手。

材料

外壳底座滑动件

改性尼龙PA6/PA66涂层的铸铝。

外壳厚度:10毫米。

座椅

HD36泡沫

原产国

意大利

"""基于说明书创建的输入:

# 提示:基于说明书创建营销描述

prompt = f"""

你的任务是帮助营销团队基于技术说明书创建一个产品的营销描述。

根据```标记的技术说明书中提供的信息,编写一个产品描述。

技术说明: ```{fact_sheet_chair}```

"""

response = get_completion(prompt)

print(response)产品描述:

我们自豪地推出美丽的中世纪风格办公家具系列,其中包括文件柜、办公桌、书柜、会议桌等。我们的产品采用多种外壳颜色和底座涂层,以满足您的个性化需求。您可以选择塑料前后靠背装饰(SWC-100)或10种面料和6种皮革的全面装饰(SWC-110),以使您的办公室更加舒适和时尚。

我们的底座涂层选项包括不锈钢、哑光黑色、光泽白色或铬,以满足您的不同需求。椅子可带或不带扶手,适用于家庭或商业场所。我们的产品符合合同使用资格,为您提供更加可靠的保障。

我们的产品采用五个轮子的塑料涂层铝底座,气动椅子调节,方便升降。尺寸为宽度53厘米|20.87英寸,深度51厘米|20.08英寸,高度80厘米|31.50英寸,座椅高度44厘米|17.32英寸,座椅深度41厘米|16.14英寸,为您提供舒适的使用体验。

我们的产品还提供软地板或硬地板滚轮选项,两种座椅泡沫密度可选:中等(1.8磅/立方英尺)或高(2.8磅/立方英尺),以及无扶手或8个位置PU扶手,以满足您的不同需求。

我们的产品采用改性尼龙PA6/PA66涂层的铸铝外壳底座滑动件,外壳厚度为10毫米,座椅采用HD36泡沫,为您提供更加舒适的使用体验。我们的产品原产国为意大利,为您提供更加优质的品质保证。它似乎很好地写了一个描述,介绍了一个惊人的中世纪灵感办公椅,很好地完成了要求,即从技术说明书开始编写产品描述。但是当我看到这个时,我会觉得这个太长了。 所以我有了一个想法,我写了一个提示,得到了结果。但是我对它不是很满意,因为它太长了,所以我会澄清我的提示,并说最多使用50个字。 因此,我通过要求它限制生成文本长度来解决这一问题。 输入:

# 优化后的 Prompt,要求生成描述不多于 50 词

prompt = f"""

您的任务是帮助营销团队基于技术说明书创建一个产品的零售网站描述。

根据```标记的技术说明书中提供的信息,编写一个产品描述。

使用最多50个词。

技术规格:```{fact_sheet_chair}```

"""

response = get_completion(prompt)

print(response)

print(f"文本长度:{len(response)}")输出:

中世纪风格办公家具系列,包括文件柜、办公桌、书柜、会议桌等。多种颜色和涂层可选,可带或不带扶手。底座涂层选项为不锈钢、哑光黑色、光泽白色或铬。适用于家庭或商业场所,符合合同使用资格。意大利制造。

文本长度:97由于中文需要分词,此处直接计算整体长度,结果为 97 个词。 LLM 在遵循非常精确的字数限制方面表现得还可以,但并不那么出色。有时它会输出60或65个单词的内容,但这还算是合理的。这原因是 LLM 解释文本使用一种叫做分词器的东西,但它们往往在计算字符方面表现一般般。有很多不同的方法来尝试控制你得到的输出的长度。 问题二:文本关注在错误的细节上 我们会发现的第二个问题是,这个网站并不是直接向消费者销售,它实际上旨在向家具零售商销售家具,他们会更关心椅子的技术细节和材料。在这种情况下,你可以修改这个提示,让它更精确地描述椅子的技术细节。 解决方法:要求它专注于与目标受众相关的方面。 输入:

# 优化后的 Prompt,说明面向对象,应具有什么性质且侧重于什么方面

prompt = f"""

您的任务是帮助营销团队基于技术说明书创建一个产品的零售网站描述。

根据```标记的技术说明书中提供的信息,编写一个产品描述。

该描述面向家具零售商,因此应具有技术性质,并侧重于产品的材料构造。

使用最多50个单词。

技术规格: ```{fact_sheet_chair}```

"""

response = get_completion(prompt)

print(response)输出:

这款中世纪风格办公家具系列包括文件柜、办公桌、书柜和会议桌等,适用于家庭或商业场所。可选多种外壳颜色和底座涂层,底座涂层选项为不锈钢、哑光黑色、光泽白色或铬。椅子可带或不带扶手,可选软地板或硬地板滚轮,两种座椅泡沫密度可选。外壳底座滑动件采用改性尼龙PA6/PA66涂层的铸铝,座椅采用HD36泡沫。原产国为意大利。我可能进一步想要在描述的结尾包括产品ID。因此,我可以进一步改进这个提示,要求在描述的结尾,包括在技术说明中的每个7个字符产品ID。 输入:

# 更进一步

prompt = f"""

您的任务是帮助营销团队基于技术说明书创建一个产品的零售网站描述。

根据```标记的技术说明书中提供的信息,编写一个产品描述。

该描述面向家具零售商,因此应具有技术性质,并侧重于产品的材料构造。

在描述末尾,包括技术规格中每个7个字符的产品ID。

使用最多50个单词。

技术规格: ```{fact_sheet_chair}```

"""

response = get_completion(prompt)

print(response)输出:

这款中世纪风格的办公家具系列包括文件柜、办公桌、书柜和会议桌等,适用于家庭或商业场所。可选多种外壳颜色和底座涂层,底座涂层选项为不锈钢、哑光黑色、光泽白色或铬。椅子可带或不带扶手,可选塑料前后靠背装饰或10种面料和6种皮革的全面装饰。座椅采用HD36泡沫,可选中等或高密度,座椅高度44厘米,深度41厘米。外壳底座滑动件采用改性尼龙PA6/PA66涂层的铸铝,外壳厚度为10毫米。原产国为意大利。产品ID:SWC-100/SWC-110。问题三:需要一个表格形式的描述 以上是许多开发人员通常会经历的迭代提示开发的简短示例。像上一章中所演示的那样,Prompt 应该保持清晰和明确,并在必要时给模型一些思考时间。在这些要求的基础上,通常值得首先尝试编写 Prompt ,看看会发生什么,然后从那里开始迭代地完善 Prompt,以逐渐接近所需的结果。因此,许多成功的Prompt都是通过这种迭代过程得出的。下面将向您展示一个更复杂的提示示例,可能会让您对 ChatGPT 的能力有更深入的了解。 这里我添加了一些额外的说明,要求它抽取信息并组织成表格,并指定表格的列、表名和格式,还要求它将所有内容格式化为可以在网页使用的 HTML。 输入:

# 要求它抽取信息并组织成表格,并指定表格的列、表名和格式

prompt = f"""

您的任务是帮助营销团队基于技术说明书创建一个产品的零售网站描述。

根据```标记的技术说明书中提供的信息,编写一个产品描述。

该描述面向家具零售商,因此应具有技术性质,并侧重于产品的材料构造。

在描述末尾,包括技术规格中每个7个字符的产品ID。

在描述之后,包括一个表格,提供产品的尺寸。表格应该有两列。第一列包括尺寸的名称。第二列只包括英寸的测量值。

给表格命名为“产品尺寸”。

将所有内容格式化为可用于网站的HTML格式。将描述放在<div>元素中。

技术规格:```{fact_sheet_chair}```

"""

response = get_completion(prompt)

print(response)输出:

<div>

<h2>中世纪风格办公家具系列椅子</h2>

<p>这款椅子是中世纪风格办公家具系列的一部分,适用于家庭或商业场所。它有多种外壳颜色和底座涂层可选,包括不锈钢、哑光黑色、光泽白色或铬。您可以选择带或不带扶手的椅子,以及软地板或硬地板滚轮选项。此外,您可以选择两种座椅泡沫密度:中等(1.8磅/立方英尺)或高(2.8磅/立方英尺)。</p>

<p>椅子的外壳底座滑动件是改性尼龙PA6/PA66涂层的铸铝,外壳厚度为10毫米。座椅采用HD36泡沫,底座是五个轮子的塑料涂层铝底座,可以进行气动椅子调节,方便升降。此外,椅子符合合同使用资格,是您理想的选择。</p>

<p>产品ID:SWC-100</p>

</div>

<table>

<caption>产品尺寸</caption>

<tr>

<th>宽度</th>

<td>20.87英寸</td>

</tr>

<tr>

<th>深度</th>

<td>20.08英寸</td>

</tr>

<tr>

<th>高度</th>

<td>31.50英寸</td>

</tr>

<tr>

<th>座椅高度</th>

<td>17.32英寸</td>

</tr>

...

<th>座椅深度</th>

<td>16.14英寸</td>

</tr>

</table>解析输出的HTML格式: 首先需要安装 IPython 模块,IPython 是一个 Python 交互式解释器,提供了比默认解释器更多的功能,例如语法高亮、代码补全、历史记录等等。

# 安装命令

pip install ipython安装后导入,并修改输出方式。

# 导入相关依赖

from IPython.display import display, HTML

print(display(HTML(response)))

解析HTML格式的输出需要一个 .ipynb 文件或创建一个 Jupyter 笔记本来运行 IPython 代码,否则会提示<IPython.core.display.HTML object>解析后输出:  本章的主要内容是 LLM 在开发应用程序中的迭代式提示开发过程。开发者需要先尝试编写提示,然后通过迭代逐步完善它,直至得到需要的结果。关键在于拥有一种有效的开发 Prompt 的过程,而不是知道完美的 Prompt。对于一些更复杂的应用程序,可以对多个样本进行迭代开发提示并进行评估。最后,可以在更成熟的应用程序中测试多个 Prompt 在多个样本上的平均或最差性能。在使用 Jupyter 代码笔记本示例时,请尝试不同的变化并查看结果。

本章的主要内容是 LLM 在开发应用程序中的迭代式提示开发过程。开发者需要先尝试编写提示,然后通过迭代逐步完善它,直至得到需要的结果。关键在于拥有一种有效的开发 Prompt 的过程,而不是知道完美的 Prompt。对于一些更复杂的应用程序,可以对多个样本进行迭代开发提示并进行评估。最后,可以在更成熟的应用程序中测试多个 Prompt 在多个样本上的平均或最差性能。在使用 Jupyter 代码笔记本示例时,请尝试不同的变化并查看结果。

3.3 文本概括

当今世界上有太多的文本信息,几乎没有人能够拥有足够的时间去阅读所有我们想了解的东西。但令人感到欣喜的是,目前 LLM 在文本概括任务上展现了强大的水准,也已经有不少团队将这项功能插入了自己的软件应用中。 本章节将介绍如何使用编程的方式,调用 API 接口来实现“文本概括”功能。 依赖引入 同上一章节,我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

import openai

import os

# 读取环境变量中的 api_key

openai.api_key = os.environ.get("OPENAI_API_KEY")

# 直接写 api_key

#openai.api_key = 'API_KEY'

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 值越低则输出文本随机性越低

)

return response.choices[0].message["content"]单一文本概括 Prompt 实验 这里我们举了个商品评论的例子。对于电商平台来说,网站上往往存在着海量的商品评论,这些评论反映了所有客户的想法。如果我们拥有一个工具去概括这些海量、冗长的评论,便能够快速地浏览更多评论,洞悉客户的偏好,从而指导平台与商家提供更优质的服务。 输入文本:

prod_review_zh = """

这个熊猫公仔是我给女儿的生日礼物,她很喜欢,去哪都带着。

公仔很软,超级可爱,面部表情也很和善。但是相比于价钱来说,

它有点小,我感觉在别的地方用同样的价钱能买到更大的。

快递比预期提前了一天到货,所以在送给女儿之前,我自己玩了会。

"""限制输出文本长度 我们尝试限制文本长度为最多30词。 输入:

prompt = f"""

你的任务是从电子商务网站上生成一个产品评论的简短摘要。

请对三个反引号之间的评论文本进行概括,最多30个词汇。

评论: ```{prod_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

可爱软熊猫公仔,女儿喜欢,面部表情和善,但价钱有点小贵,快递提前一天到货。关键角度侧重 有时,针对不同的业务,我们对文本的侧重会有所不同。例如对于商品评论文本,物流会更关心运输时效,商家更加关心价格与商品质量,平台更关心整体服务体验。 我们可以通过增加 Prompt 提示,来体现对于某个特定角度的侧重。 侧重于运输的输入:

prompt = f"""

你的任务是从电子商务网站上生成一个产品评论的简短摘要。

请对三个反引号之间的评论文本进行概括,最多30个词汇,并且聚焦在产品运输上。

评论: ```{prod_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

快递提前到货,熊猫公仔软可爱,但有点小,价钱不太划算。可以看到,输出结果以“快递提前一天到货”开头,体现了对于快递效率的侧重。 侧重于价格与质量的输入:

prompt = f"""

你的任务是从电子商务网站上生成一个产品评论的简短摘要。

请对三个反引号之间的评论文本进行概括,最多30个词汇,并且聚焦在产品价格和质量上。

评论: ```{prod_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

可爱软熊猫公仔,面部表情友好,但价钱有点高,尺寸较小。快递提前一天到货。可以看到,输出结果以“质量好、价格小贵、尺寸小”开头,体现了对于产品价格与质量的侧重。 关键信息提取 在上一节中,虽然我们通过添加关键角度侧重的 Prompt,使得文本摘要更侧重于某一特定方面,但是可以发现,结果中也会保留一些其他信息,如价格与质量角度的概括中仍保留了“快递提前到货”的信息。有时这些信息是有帮助的,但如果我们只想要提取某一角度的信息,并过滤掉其他所有信息,则可以要求 LLM 进行“文本提取(Extract)”而非“文本概括(Summarize)”。 输入:

prompt = f"""

你的任务是从电子商务网站上的产品评论中提取相关信息。

请从以下三个反引号之间的评论文本中提取产品运输相关的信息,最多30个词汇。

评论: ```{prod_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

快递比预期提前了一天到货。多条文本概括 Prompt 实验 在实际的工作流中,我们往往有许许多多的评论文本,以下展示了一个基于 for 循环调用“文本概括”工具并依次打印的示例。当然,在实际生产中,对于上百万甚至上千万的评论文本,使用 for 循环也是不现实的,可能需要考虑整合评论、分布式等方法提升运算效率。 输入:

review_1 = prod_review

# review for a standing lamp

review_2 = """

Needed a nice lamp for my bedroom, and this one \

had additional storage and not too high of a price \

point. Got it fast - arrived in 2 days. The string \

to the lamp broke during the transit and the company \

happily sent over a new one. Came within a few days \

as well. It was easy to put together. Then I had a \

missing part, so I contacted their support and they \

very quickly got me the missing piece! Seems to me \

to be a great company that cares about their customers \

and products.

"""

# review for an electric toothbrush

review_3 = """

My dental hygienist recommended an electric toothbrush, \

which is why I got this. The battery life seems to be \

pretty impressive so far. After initial charging and \

leaving the charger plugged in for the first week to \

condition the battery, I've unplugged the charger and \

been using it for twice daily brushing for the last \

3 weeks all on the same charge. But the toothbrush head \

is too small. I’ve seen baby toothbrushes bigger than \

this one. I wish the head was bigger with different \

length bristles to get between teeth better because \

this one doesn’t. Overall if you can get this one \

around the $50 mark, it's a good deal. The manufactuer's \

replacements heads are pretty expensive, but you can \

get generic ones that're more reasonably priced. This \

toothbrush makes me feel like I've been to the dentist \

every day. My teeth feel sparkly clean!

"""

# review for a blender

review_4 = """

So, they still had the 17 piece system on seasonal \

sale for around $49 in the month of November, about \

half off, but for some reason (call it price gouging) \

around the second week of December the prices all went \

up to about anywhere from between $70-$89 for the same \

system. And the 11 piece system went up around $10 or \

so in price also from the earlier sale price of $29. \

So it looks okay, but if you look at the base, the part \

where the blade locks into place doesn’t look as good \

as in previous editions from a few years ago, but I \

plan to be very gentle with it (example, I crush \

very hard items like beans, ice, rice, etc. in the \

blender first then pulverize them in the serving size \

I want in the blender then switch to the whipping \

blade for a finer flour, and use the cross cutting blade \

first when making smoothies, then use the flat blade \

if I need them finer/less pulpy). Special tip when making \

smoothies, finely cut and freeze the fruits and \

vegetables (if using spinach-lightly stew soften the \

spinach then freeze until ready for use-and if making \

sorbet, use a small to medium sized food processor) \

that you plan to use that way you can avoid adding so \

much ice if at all-when making your smoothie. \

After about a year, the motor was making a funny noise. \

I called customer service but the warranty expired \

already, so I had to buy another one. FYI: The overall \

quality has gone done in these types of products, so \

they are kind of counting on brand recognition and \

consumer loyalty to maintain sales. Got it in about \

two days.

"""

reviews = [review_1, review_2, review_3, review_4]通过 for 循环提取:

for i in range(len(reviews)):

prompt = f"""

Your task is to generate a short summary of a product \

review from an ecommerce site.

Summarize the review below, delimited by triple \

backticks in at most 20 words.

Review: ```{reviews[i]}```

"""

response = get_completion(prompt)

print(i, response, "\n")

输出:

0 Soft and cute panda plush toy loved by daughter, but a bit small for the price. Arrived early.

1 Affordable lamp with storage, fast shipping, and excellent customer service. Easy to assemble and missing parts were quickly replaced.

2 Good battery life, small toothbrush head, but effective cleaning. Good deal if bought around $50.

3 The product was on sale for $49 in November, but the price increased to $70-$89 in December. The base doesn't look as good as previous editions, but the reviewer plans to be gentle with it. A special tip for making smoothies is to freeze the fruits and vegetables beforehand. The motor made a funny noise after a year, and the warranty had expired. Overall quality has decreased.3.4 文本推断

在这节课中,你将从产品评论和新闻文章中推断情感和主题。

这些任务可以看作是模型接收文本作为输入并执行某种分析的过程。这可能涉及提取标签、提取实体、理解文本情感等等。如果你想要从一段文本中提取正面或负面情感,在传统的机器学习工作流程中,需要收集标签数据集、训练模型、确定如何在云端部署模型并进行推断。这样做可能效果还不错,但是这个过程需要很多工作。而且对于每个任务,如情感分析、提取实体等等,都需要训练和部署单独的模型。

大型语言模型的一个非常好的特点是,对于许多这样的任务,你只需要编写一个 prompt 即可开始产生结果,而不需要进行大量的工作。这极大地加快了应用程序开发的速度。你还可以只使用一个模型和一个 API 来执行许多不同的任务,而不需要弄清楚如何训练和部署许多不同的模型。

依赖引入

同上一章节,我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

import openai

import os

# 读取环境变量中的 api_key

openai.api_key = os.environ.get("OPENAI_API_KEY")

# 直接写 api_key

#openai.api_key = 'API_KEY'

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 值越低则输出文本随机性越低

)

return response.choices[0].message["content"]商品评论 通过商品评论来推断其情感、提取实体及相关信息。

文本:

lamp_review_zh = """

我需要一盏漂亮的卧室灯,这款灯具有额外的储物功能,价格也不算太高。\

我很快就收到了它。在运输过程中,我们的灯绳断了,但是公司很乐意寄送了一个新的。\

几天后就收到了。这款灯很容易组装。我发现少了一个零件,于是联系了他们的客服,他们很快就给我寄来了缺失的零件!\

在我看来,Lumina 是一家非常关心顾客和产品的优秀公司!

"""情感(正向/负向)

现在让我们来编写一个 prompt 来分类这个评论的情感。如果我想让系统告诉我这个评论的情感是什么,只需要编写 “以下产品评论的情感是什么” 这个 prompt,加上通常的分隔符和评论文本等等。

然后让我们运行一下。结果显示这个产品评论的情感是积极的,这似乎是非常正确的。虽然这盏台灯不完美,但这个客户似乎非常满意。这似乎是一家关心客户和产品的伟大公司,可以认为积极的情感似乎是正确的答案。

输入:

prompt = f"""

以下用三个反引号分隔的产品评论的情感是什么?

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

情感是积极的/正面的。如果你想要给出更简洁的答案,以便更容易进行后处理,可以使用上面的 prompt 并添加另一个指令,以一个单词 “正面” 或 “负面” 的形式给出答案。这样就只会打印出 “正面” 这个单词,这使得文本更容易接受这个输出并进行处理。

输入:

prompt = f"""

以下用三个反引号分隔的产品评论的情感是什么?

用一个单词回答:「正面」或「负面」。

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

正面识别情感类型

让我们看看另一个 prompt,仍然使用台灯评论。这次我要让它识别出以下评论作者所表达的情感列表,不超过五个。

输入:

# 中文

prompt = f"""

识别以下评论的作者表达的情感。包含不超过五个项目。将答案格式化为以逗号分隔的单词列表。

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

满意,感激,信任,赞扬,愉快大型语言模型非常擅长从一段文本中提取特定的东西。在上面的例子中,评论正在表达情感,这可能有助于了解客户如何看待特定的产品。

识别愤怒

对于很多企业来说,了解某个顾客是否非常生气很重要。所以你可能有一个类似这样的分类问题:以下评论的作者是否表达了愤怒情绪?因为如果有人真的很生气,那么可能值得额外关注,让客户支持或客户成功团队联系客户以了解情况,并为客户解决问题。

输入:

# 中文

prompt = f"""

以下评论的作者是否表达了愤怒?评论用三个反引号分隔。给出是或否的答案。

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

否上面这个例子中,客户并没有生气。注意,如果使用常规的监督学习,如果想要建立所有这些分类器,不可能在几分钟内就做到这一点。我们鼓励大家尝试更改一些这样的 prompt,也许询问客户是否表达了喜悦,或者询问是否有任何遗漏的部分,并看看是否可以让 prompt 对这个灯具评论做出不同的推论。

从客户评论中提取产品和公司名称

接下来,让我们从客户评论中提取更丰富的信息。信息提取是自然语言处理(NLP)的一部分,与从文本中提取你想要知道的某些事物相关。因此,在这个 prompt 中,我要求它识别以下内容:购买物品和制造物品的公司名称。

同样,如果你试图总结在线购物电子商务网站的许多评论,对于这些评论来说,弄清楚是什么物品,谁制造了该物品,弄清楚积极和消极的情感,以跟踪特定物品或特定制造商的积极或消极情感趋势,可能会很有用。

在下面这个示例中,我们要求它将响应格式化为一个 JSON 对象,其中物品和品牌是键。

输入:

prompt = f"""

从评论文本中识别以下项目:

- 评论者购买的物品

- 制造该物品的公司

评论文本用三个反引号分隔。将你的响应格式化为以 “物品” 和 “品牌” 为键的 JSON 对象。

如果信息不存在,请使用 “未知” 作为值。

让你的回应尽可能简短。

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

{

"物品": "卧室灯",

"品牌": "Lumina"

}如上所示,它会说这个物品是一个卧室灯,品牌是 Luminar,你可以轻松地将其加载到 Python 字典中,然后对此输出进行其他处理。

一次完成多项任务

提取上面所有这些信息使用了 3 或 4 个 prompt,但实际上可以编写单个 prompt 来同时提取所有这些信息。

输入:

prompt = f"""

从评论文本中识别以下项目:

- 情绪(正面或负面)

- 审稿人是否表达了愤怒?(是或否)

- 评论者购买的物品

- 制造该物品的公司

评论用三个反引号分隔。将您的响应格式化为 JSON 对象,以 “Sentiment”、“Anger”、“Item” 和 “Brand” 作为键。

如果信息不存在,请使用 “未知” 作为值。

让你的回应尽可能简短。

将 Anger 值格式化为布尔值。

评论文本: ```{lamp_review_zh}```

"""

response = get_completion(prompt)

print(response)输出:

{

"Sentiment": "正面",

"Anger": false,

"Item": "卧室灯",

"Brand": "Lumina"

}这个例子中,我们告诉它将愤怒值格式化为布尔值,然后输出一个 JSON。大家可以自己尝试不同的变化,或者甚至尝试完全不同的评论,看看是否仍然可以准确地提取这些内容。

推断主题:

大型语言模型的一个很酷的应用是推断主题。给定一段长文本,这段文本是关于什么的?有什么话题?

文本:

story_zh = """

在政府最近进行的一项调查中,要求公共部门的员工对他们所在部门的满意度进行评分。

调查结果显示,NASA 是最受欢迎的部门,满意度为 95%。

一位 NASA 员工 John Smith 对这一发现发表了评论,他表示:

“我对 NASA 排名第一并不感到惊讶。这是一个与了不起的人们和令人难以置信的机会共事的好地方。我为成为这样一个创新组织的一员感到自豪。”

NASA 的管理团队也对这一结果表示欢迎,主管 Tom Johnson 表示:

“我们很高兴听到我们的员工对 NASA 的工作感到满意。

我们拥有一支才华横溢、忠诚敬业的团队,他们为实现我们的目标不懈努力,看到他们的辛勤工作得到回报是太棒了。”

调查还显示,社会保障管理局的满意度最低,只有 45%的员工表示他们对工作满意。

政府承诺解决调查中员工提出的问题,并努力提高所有部门的工作满意度。

"""推断5个主题

上面是一篇虚构的关于政府工作人员对他们工作机构感受的报纸文章。我们可以让它确定五个正在讨论的主题,用一两个字描述每个主题,并将输出格式化为逗号分隔的列表。

输入:

prompt = f"""

确定以下给定文本中讨论的五个主题。

每个主题用1-2个单词概括。

输出时用逗号分割每个主题。

给定文本: ```{story_zh}```

"""

response = get_completion(prompt)

print(response)调查结果, NASA, 社会保障管理局, 员工满意度, 政府承诺为特定主题制作新闻提醒

假设我们有一个新闻网站或类似的东西,这是我们感兴趣的主题:NASA、地方政府、工程、员工满意度、联邦政府等。假设我们想弄清楚,针对一篇新闻文章,其中涵盖了哪些主题。可以使用这样的 prompt:确定以下主题列表中的每个项目是否是以下文本中的主题。以 0 或 1 的形式给出答案列表。

输入:

prompt = f"""

判断主题列表中的每一项是否是给定文本中的一个话题,

以列表的形式给出答案,每个主题用 0 或 1。

主题列表:美国航空航天局、地方政府、工程、员工满意度、联邦政府

给定文本: ```{story_zh}```

"""

response = get_completion(prompt)

print(response)输出:

美国航空航天局:1

地方政府:1

工程:0

员工满意度:1

联邦政府:1所以,这个故事是关于 NASA 的。它不是关于地方政府的,不是关于工程的。它是关于员工满意度的,它是关于联邦政府的。这在机器学习中有时被称为 Zero-Shot 学习算法,因为我们没有给它任何标记的训练数据。仅凭 prompt,它就能确定哪些主题在新闻文章中涵盖了。

如果我们想生成一个新闻提醒,也可以使用这个处理新闻的过程。假设我非常喜欢 NASA 所做的工作,就可以构建一个这样的系统,每当 NASA 新闻出现时,输出提醒。

输入:

prompt = f"""

判断主题列表中的每一项是否是给定文本中的一个话题,

以列表的形式给出答案,每个主题用 0 或 1。

主题列表:美国航空航天局、地方政府、工程、员工满意度、联邦政府

给定文本: ```{story_zh}```

"""

response = get_completion(prompt)

topic_dict = {i.split(':')[0]: int(i.split(':')[1]) for i in response.split(sep='\n')}

if topic_dict['美国航空航天局'] == 1:

print("提醒: 关于美国航空航天局的新消息")

else:

print(response)输出:

提醒: 关于美国航空航天局的新消息这就是关于推断的全部内容了,仅用几分钟时间,我们就可以构建多个用于对文本进行推理的系统,而以前则需要熟练的机器学习开发人员数天甚至数周的时间。这非常令人兴奋,无论是对于熟练的机器学习开发人员还是对于新手来说,都可以使用 prompt 来非常快速地构建和开始相当复杂的自然语言处理任务。

3.5 文本转换

LLM 非常擅长将输入转换成不同的格式,例如多语种文本翻译、拼写及语法纠正、语气调整、格式转换等。

本章节将介绍如何使用编程的方式,调用 API 接口来实现“文本转换”功能。

依赖引入

同上一章节,我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

import openai

import os

# 读取环境变量中的 api_key

openai.api_key = os.environ.get("OPENAI_API_KEY")

# 直接写 api_key

#openai.api_key = 'API_KEY'

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 值越低则输出文本随机性越低

)

return response.choices[0].message["content"]文本翻译

中文转西班牙语

输入:

prompt = f"""

将以下中文翻译成西班牙语: \

```您好,我想订购一个搅拌机。```

"""

response = get_completion(prompt)

print(response)输出:

Hola, me gustaría ordenar una batidora.识别语种

输入:

prompt = f"""

请告诉我以下文本是什么语种:

```Combien coûte le lampadaire?```

"""

response = get_completion(prompt)

print(response)输出:

这是法语。多语种翻译

输入:

prompt = f"""

请将以下文本分别翻译成中文、英文、法语和西班牙语:

```I want to order a basketball.```

"""

response = get_completion(prompt)

print(response)输出:

中文:我想订购一个篮球。

英文:I want to order a basketball.

法语:Je veux commander un ballon de basket.

西班牙语:Quiero pedir una pelota de baloncesto.翻译+正式语气

输入:

prompt = f"""

请将以下文本翻译成中文,分别展示成正式与非正式两种语气:

```Would you like to order a pillow?```

"""

response = get_completion(prompt)

print(response)正式语气:请问您需要订购枕头吗?

非正式语气:你要不要订一个枕头?通用翻译器

随着全球化与跨境商务的发展,交流的用户可能来自各个不同的国家,使用不同的语言,因此我们需要一个通用翻译器,识别各个消息的语种,并翻译成目标用户的母语,从而实现更方便的跨国交流。

输入文本:

user_messages = [

"La performance du système est plus lente que d'habitude.", # System performance is slower than normal

"Mi monitor tiene píxeles que no se iluminan.", # My monitor has pixels that are not lighting

"Il mio mouse non funziona", # My mouse is not working

"Mój klawisz Ctrl jest zepsuty", # My keyboard has a broken control key

"我的屏幕在闪烁" # My screen is flashing

]写入循环:

for issue in user_messages:

prompt = f"告诉我以下文本是什么语种,直接输出语种,如法语,无需输出标点符号: ```{issue}```"

lang = get_completion(prompt)

print(f"原始消息 ({lang}): {issue}\n")

prompt = f"""

将以下消息分别翻译成英文和中文,并写成

中文翻译:xxx

英文翻译:yyy

的格式:

```{issue}```

"""

response = get_completion(prompt)

print(response, "\n=========================================")输出:

原始消息 (法语): La performance du système est plus lente que d'habitude.

中文翻译:系统性能比平时慢。

英文翻译:The system performance is slower than usual.

=========================================

原始消息 (西班牙语): Mi monitor tiene píxeles que no se iluminan.

中文翻译:我的显示器有一些像素点不亮。

英文翻译:My monitor has pixels that don't light up.

=========================================

原始消息 (意大利语): Il mio mouse non funziona

中文翻译:我的鼠标不工作了。

英文翻译:My mouse is not working.

=========================================

原始消息 (波兰语): Mój klawisz Ctrl jest zepsuty

中文翻译:我的Ctrl键坏了

英文翻译:My Ctrl key is broken.

=========================================

原始消息 (中文): 我的屏幕在闪烁

中文翻译:我的屏幕在闪烁。

英文翻译:My screen is flickering.

=========================================语气/风格调整

写作的语气往往会根据受众对象而有所调整。例如,对于工作邮件,我们常常需要使用正式语气与书面用词,而对同龄朋友的微信聊天,可能更多地会使用轻松、口语化的语气。

输入:

prompt = f"""

将以下文本翻译成商务信函的格式:

```小老弟,我小羊,上回你说咱部门要采购的显示器是多少寸来着?```

"""

response = get_completion(prompt)

print(response)输出:

尊敬的XXX(收件人姓名):

您好!我是XXX(发件人姓名),在此向您咨询一个问题。上次我们交流时,您提到我们部门需要采购显示器,但我忘记了您所需的尺寸是多少英寸。希望您能够回复我,以便我们能够及时采购所需的设备。

谢谢您的帮助!

此致

敬礼

XXX(发件人姓名)格式转换

ChatGPT 非常擅长不同格式之间的转换,例如 JSON 到HTML、XML、Markdown 等。在下述例子中,我们有一个包含餐厅员工姓名和电子邮件的列表的 JSON,我们希望将其从 JSON 转换为 HTML。

输入JSON:

data_json = { "resturant employees" :[

{"name":"Shyam", "email":"[email protected]"},

{"name":"Bob", "email":"[email protected]"},

{"name":"Jai", "email":"[email protected]"}

]}prompt = f"""

将以下Python字典从JSON转换为HTML表格,保留表格标题和列名:{data_json}

"""

response = get_completion(prompt)

print(response)运行后输出html:

<table>

<caption>resturant employees</caption>

<thead>

<tr>

<th>name</th>

<th>email</th>

</tr>

</thead>

<tbody>

<tr>

<td>Shyam</td>

<td>[email protected]</td>

</tr>

<tr>

<td>Bob</td>

<td>[email protected]</td>

</tr>

<tr>

<td>Jai</td>

<td>[email protected]</td>

</tr>

</tbody>

</table>转换输出的HTML格式:

首先需要安装 IPython 模块,IPython 是一个 Python 交互式解释器,提供了比默认解释器更多的功能,例如语法高亮、代码补全、历史记录等等。

# 安装命令

pip install ipython安装后导入,并修改输出方式。

# 导入相关依赖

from IPython.display import display, Markdown, Latex, HTML, JSON

print(display(HTML(response)))提示:解析 HTML 格式的输出需要一个 .ipynb 文件或创建一个 Jupyter 笔记本来运行 IPython 代码,否则会提示<IPython.core.display.HTML object>

转换后输出:

拼写及语法纠正

拼写及语法的检查与纠正是一个十分常见的需求,特别是使用非母语语言,例如发表英文论文时,这是一件十分重要的事情。

以下给了一个例子,有一个句子列表,其中有些句子存在拼写或语法问题,有些则没有,我们循环遍历每个句子,要求模型校对文本,如果正确则输出“未发现错误”,如果错误则输出纠正后的文本。

文本:

text = [

"The girl with the black and white puppies have a ball.", # The girl has a ball.

"Yolanda has her notebook.", # ok

"Its going to be a long day. Does the car need it’s oil changed?", # Homonyms

"Their goes my freedom. There going to bring they’re suitcases.", # Homonyms

"Your going to need you’re notebook.", # Homonyms

"That medicine effects my ability to sleep. Have you heard of the butterfly affect?", # Homonyms

"This phrase is to cherck chatGPT for spelling abilitty" # spelling

]输入:

for i in range(len(text)):

prompt = f"""请校对并更正以下文本,注意纠正文本保持原始语种,无需输出原始文本。

如果您没有发现任何错误,请说“未发现错误”。

例如:

输入:I are happy.

输出:I am happy.

```{text[i]}```"""

response = get_completion(prompt)

print(i, response)输出:

0 The girl with the black and white puppies has a ball.

1 未发现错误。

2 It's going to be a long day. Does the car need its oil changed?

3 Their goes my freedom. They're going to bring their suitcases.

4 输出:You're going to need your notebook.

5 That medicine affects my ability to sleep. Have you heard of the butterfly effect?

6 This phrase is to check chatGPT for spelling ability.以下是一个简单的类 Grammarly 纠错示例,输入原始文本,输出纠正后的文本,并基于 Redlines 输出纠错过程。

文本:

text = f"""

Got this for my daughter for her birthday cuz she keeps taking \

mine from my room. Yes, adults also like pandas too. She takes \

it everywhere with her, and it's super soft and cute. One of the \

ears is a bit lower than the other, and I don't think that was \

designed to be asymmetrical. It's a bit small for what I paid for it \

though. I think there might be other options that are bigger for \

the same price. It arrived a day earlier than expected, so I got \

to play with it myself before I gave it to my daughter.

"""输入:

prompt = f"校对并更正以下商品评论:```{text}```"

response = get_completion(prompt)

print(response)输出:

I got this for my daughter's birthday because she keeps taking mine from my room. Yes, adults also like pandas too. She takes it everywhere with her, and it's super soft and cute. However, one of the ears is a bit lower than the other, and I don't think that was designed to be asymmetrical. It's also a bit smaller than I expected for the price. I think there might be other options that are bigger for the same price. On the bright side, it arrived a day earlier than expected, so I got to play with it myself before giving it to my daughter.将输出结果与原文本对比:

# 如未安装redlines,需先安装

pip3 install redlines #python3

或

pip2 install redlines #python2from redlines import Redlines

from IPython.display import display, Markdown

response = """

I got this for my daughter's birthday because she keeps taking mine from my room. Yes, adults also like pandas too. She takes it everywhere with her, and it's super soft and cute. However, one of the ears is a bit lower than the other, and I don't think that was designed to be asymmetrical. It's also a bit smaller than I expected for the price. I think there might be other options that are bigger for the same price. On the bright side, it arrived a day earlier than expected, so I got to play with it myself before giving it to my daughter.

"""

diff = Redlines(text,response)

print(display(Markdown(diff.output_markdown)))提示:解析 MarkDown 格式的输出需要一个 .ipynb 文件或创建一个 Jupyter 笔记本来运行 IPython 代码,否则会提示<IPython.core.display.HTML object>

对比结果如下:

一个综合样例:文本翻译+拼写纠正+风格调整+格式转换

文本:

text = f"""

Got this for my daughter for her birthday cuz she keeps taking \

mine from my room. Yes, adults also like pandas too. She takes \

it everywhere with her, and it's super soft and cute. One of the \

ears is a bit lower than the other, and I don't think that was \

designed to be asymmetrical. It's a bit small for what I paid for it \

though. I think there might be other options that are bigger for \

the same price. It arrived a day earlier than expected, so I got \

to play with it myself before I gave it to my daughter.

"""输入:

prompt = f"""

针对以下三个反引号之间的英文评论文本,

首先进行拼写及语法纠错,

然后将其转化成中文,

再将其转化成优质淘宝评论的风格,从各种角度出发,分别说明产品的优点与缺点,并进行总结。

润色一下描述,使评论更具有吸引力。

输出结果格式为:

【优点】xxx

【缺点】xxx

【总结】xxx

注意,只需填写xxx部分,并分段输出。

将结果输出成Markdown格式。

```{text}```

"""

response = get_completion(prompt)

display(Markdown(response))输出:

【优点】

超级柔软可爱,女儿生日礼物非常受欢迎。

成人也喜欢熊猫,我也很喜欢它。

提前一天到货,让我有时间玩一下。

【缺点】

一只耳朵比另一只低,不对称。

价格有点贵,但尺寸有点小,可能有更大的同价位选择。

【总结】 这只熊猫玩具非常适合作为生日礼物,柔软可爱,深受孩子喜欢。虽然价格有点贵,但尺寸有点小,不对称的设计也有点让人失望。如果你想要更大的同价位选择,可能需要考虑其他选项。总的来说,这是一款不错的熊猫玩具,值得购买。3.6 文本扩展

扩展是将短文本,例如一组说明或主题列表,输入到大型语言模型中,让模型生成更长的文本,例如基于某个主题的电子邮件或论文。这样做有一些很好的用途,例如将大型语言模型用作头脑风暴的伙伴。但这种做法也存在一些问题,例如某人可能会使用它来生成大量垃圾邮件。因此,当你使用大型语言模型的这些功能时,请仅以负责任的方式和有益于人们的方式使用它们。

在本章中,你将学会如何基于 OpenAI API 生成适用于每个客户评价的客户服务电子邮件。我们还将使用模型的另一个输入参数称为温度,这种参数允许您在模型响应中变化探索的程度和多样性。

依赖引入

我们需要导入 OpenAI 第三方库,并加载 API 密钥,定义 getCompletion 函数。

import openai

import os

# 读取环境变量中的 api_key

openai.api_key = os.environ.get("OPENAI_API_KEY")

# 直接写 api_key

#openai.api_key = 'API_KEY'

# 一个封装 OpenAI 接口的函数,参数为 Prompt,返回对应结果

def get_completion(prompt, model="gpt-3.5-turbo", temperature=0):

'''

prompt: 对应的提示

model: 调用的模型,默认为 gpt-3.5-turbo(ChatGPT),有内测资格的用户可以选择 gpt-4

temperature: 温度系数

'''

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=temperature, # 模型输出的温度系数,控制输出的随机程度

)

# 调用 OpenAI 的 ChatCompletion 接口

return response.choices[0].message["content"]定制客户邮件

我们将根据客户评价和情感撰写自定义电子邮件响应。因此,我们将给定客户评价和情感,并生成自定义响应即使用 LLM 根据客户评价和评论情感生成定制电子邮件。

文本:

# 我们可以在推理那章学习到如何对一个评论判断其情感倾向

sentiment = "negative"

# 一个产品的评价

review = f"""

他们在11月份的季节性销售期间以约49美元的价格出售17件套装,折扣约为一半。\

但由于某些原因(可能是价格欺诈),到了12月第二周,同样的套装价格全都涨到了70美元到89美元不等。\

11件套装的价格也上涨了大约10美元左右。\

虽然外观看起来还可以,但基座上锁定刀片的部分看起来不如几年前的早期版本那么好。\

不过我打算非常温柔地使用它,例如,\

我会先在搅拌机中将像豆子、冰、米饭等硬物研磨,然后再制成所需的份量,\

切换到打蛋器制作更细的面粉,或者在制作冰沙时先使用交叉切割刀片,然后使用平面刀片制作更细/不粘的效果。\

制作冰沙时,特别提示:\

将水果和蔬菜切碎并冷冻(如果使用菠菜,则轻轻煮软菠菜,然后冷冻直到使用;\

如果制作果酱,则使用小到中号的食品处理器),这样可以避免在制作冰沙时添加太多冰块。\

大约一年后,电机发出奇怪的噪音,我打电话给客服,但保修已经过期了,所以我不得不再买一个。\

总的来说,这些产品的总体质量已经下降,因此它们依靠品牌认可和消费者忠诚度来维持销售。\

货物在两天内到达。

"""我们已经使用推断课程中学到的提取了情感,这是一个关于搅拌机的客户评价,现在我们将根据情感定制回复。

这里的指令是:假设你是一个客户服务 AI 助手,你的任务是为客户发送电子邮件回复,根据通过三个反引号分隔的客户电子邮件,生成一封回复以感谢客户的评价。

输入:

prompt = f"""

你是一位客户服务的AI助手。

你的任务是给一位重要客户发送邮件回复。

根据客户通过“```”分隔的评价,生成回复以感谢客户的评价。提醒模型使用评价中的具体细节

用简明而专业的语气写信。

作为“AI客户代理”签署电子邮件。

客户评论:

```{review}```

评论情感:{sentiment}

"""

response = get_completion(prompt)

print(response)输出:

尊敬的客户,

非常感谢您对我们产品的评价。我们非常抱歉您在购买过程中遇到了价格上涨的问题。我们一直致力于为客户提供最优惠的价格,但由于市场波动,价格可能会有所变化。我们深表歉意,如果您需要任何帮助,请随时联系我们的客户服务团队。

我们非常感谢您对我们产品的详细评价和使用技巧。我们将会把您的反馈传达给我们的产品团队,以便改进我们的产品质量和性能。

再次感谢您对我们的支持和反馈。如果您需要任何帮助或有任何疑问,请随时联系我们的客户服务团队。

祝您一切顺利!

AI客户代理使用温度系数

接下来,我们将使用语言模型的一个称为“温度”的参数,它将允许我们改变模型响应的多样性。您可以将温度视为模型探索或随机性的程度。

例如,在一个特定的短语中,“我的最爱食品”最有可能的下一个词是“比萨”,其次最有可能的是“寿司”和“塔可”。因此,在温度为零时,模型将总是选择最有可能的下一个词,而在较高的温度下,它还将选择其中一个不太可能的词,在更高的温度下,它甚至可能选择塔可,而这种可能性仅为五分之一。您可以想象,随着模型继续生成更多单词的最终响应,“我的最爱食品是比萨”将会与第一个响应“我的最爱食品是塔可”产生差异。因此,随着模型的继续,这两个响应将变得越来越不同。

一般来说,在构建需要可预测响应的应用程序时,我建议使用温度为零。在所有课程中,我们一直设置温度为零,如果您正在尝试构建一个可靠和可预测的系统,我认为您应该选择这个温度。如果您尝试以更具创意的方式使用模型,可能需要更广泛地输出不同的结果,那么您可能需要使用更高的温度。

输入:

prompt = f"""

你是一名客户服务的AI助手。

你的任务是给一位重要的客户发送邮件回复。

根据通过“```”分隔的客户电子邮件生成回复,以感谢客户的评价。

如果情感是积极的或中性的,感谢他们的评价。

如果情感是消极的,道歉并建议他们联系客户服务。

请确保使用评论中的具体细节。

以简明和专业的语气写信。

以“AI客户代理”的名义签署电子邮件。

客户评价:```{review}```

评论情感:{sentiment}

"""

response = get_completion(prompt, temperature=0.7)

print(response)输出:

尊敬的客户,

非常感谢您对我们产品的评价。我们由衷地为您在购买过程中遇到的问题表示抱歉。我们确实在12月份的第二周调整了价格,但这是由于市场因素所致,并非价格欺诈。我们深刻意识到您对产品质量的担忧,我们将尽一切努力改进产品,以提供更好的体验。

我们非常感激您对我们产品的使用经验和制作技巧的分享。您的建议和反馈对我们非常重要,我们将以此为基础,进一步改进我们的产品。

如果您有任何疑问或需要进一步帮助,请随时联系我们的客户服务部门。我们将尽快回复您并提供帮助。

最后,请再次感谢您对我们产品的评价和选择。我们期待着未来与您的合作。

此致

敬礼

AI客户代理在温度为零时,每次执行相同的提示时,您应该期望获得相同的完成。而使用温度为0.7,则每次都会获得不同的输出。

所以,您可以看到它与我们之前收到的电子邮件不同。让我们再次执行它,以显示我们将再次获得不同的电子邮件。

因此,我建议您自己尝试温度,以查看输出如何变化。总之,在更高的温度下,模型的输出更加随机。您几乎可以将其视为在更高的温度下,助手更易分心,但也许更有创造力。

3.7 聊天机器人

使用一个大型语言模型的一个令人兴奋的事情是,我们可以用它来构建一个定制的聊天机器人,只需要很少的工作量。在这一节中,我们将探索如何利用聊天格式(接口)与个性化或专门针对特定任务或行为的聊天机器人进行延伸对话。

依赖引入

像 ChatGPT 这样的聊天模型实际上是组装成以一系列消息作为输入,并返回一个模型生成的消息作为输出的。虽然聊天格式的设计旨在使这种多轮对话变得容易,但我们通过之前的学习可以知道,它对于没有任何对话的单轮任务也同样有用。

接下来,我们将定义两个辅助函数。第一个是单轮的,我们将prompt放入看起来像是某种用户消息的东西中。另一个则传入一个消息列表。这些消息可以来自不同的角色,我们会描述一下这些角色。

第一条消息是一个系统消息,它提供了一个总体的指示,然后在这个消息之后,我们有用户和助手之间的交替。如果你曾经使用过 ChatGPT 网页界面,那么你的消息是用户消息,而 ChatGPT 的消息是助手消息。系统消息则有助于设置助手的行为和角色,并作为对话的高级指示。你可以想象它在助手的耳边低语,引导它的回应,而用户不会注意到系统消息。

因此,作为用户,如果你曾经使用过 ChatGPT,你可能不知道 ChatGPT 的系统消息是什么,这是有意为之的。系统消息的好处是为开发者提供了一种方法,在不让请求本身成为对话的一部分的情况下,引导助手并指导其回应。

import os

import openai

OPENAI_API_KEY = os.environ.get("OPENAI_API_KEY")

openai.api_key = OPENAI_API_KEY

def get_completion(prompt, model="gpt-3.5-turbo"):

messages = [{"role": "user", "content": prompt}]

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=0, # 控制模型输出的随机程度

)

return response.choices[0].message["content"]

def get_completion_from_messages(messages, model="gpt-3.5-turbo", temperature=0):

response = openai.ChatCompletion.create(

model=model,

messages=messages,

temperature=temperature, # 控制模型输出的随机程度

)

# print(str(response.choices[0].message))

return response.choices[0].message["content"]对话聊天

现在让我们尝试在对话中使用这些消息。我们将使用上面的函数来获取从这些消息中得到的回答,同时,使用更高的 temperature(值越高生成的越多样)。

系统消息说,你是一个说话像莎士比亚的助手。这是我们向助手描述它应该如何表现的方式。然后,第一个用户消息是,给我讲个笑话。接下来的消息是,为什么鸡会过马路?然后最后一个用户消息是,我不知道。

输入:

messages = [

{'role':'system', 'content':'你是一个像莎士比亚一样说话的助手。'},

{'role':'user', 'content':'给我讲个笑话'},

{'role':'assistant', 'content':'鸡为什么过马路'},

{'role':'user', 'content':'我不知道'} ]

response = get_completion_from_messages(messages, temperature=1)

print(response)输出:

因为它要去找“母鸡”。哈哈哈!(注:此为英文双关语,"chicken"是鸡的意思,也是胆小的意思;"cross the road"是过马路的意思,也是“破坏规则”的意思。)让我们做另一个例子。助手的消息是,你是一个友好的聊天机器人,第一个用户消息是,嗨,我叫 Isa。我们想要得到第一个用户消息。

输入:

messages = [

{'role':'system', 'content':'你是个友好的聊天机器人。'},

{'role':'user', 'content':'Hi, 我是Isa。'} ]

response = get_completion_from_messages(messages, temperature=1)

print(response)输出:

嗨,Isa,很高兴见到你!有什么我可以帮助你的吗?让我们再试一个例子。系统消息是,你是一个友好的聊天机器人,第一个用户消息是,是的,你能提醒我我的名字是什么吗?

输入:

messages = [

{'role':'system', 'content':'你是个友好的聊天机器人。'},

{'role':'user', 'content':'好,你能提醒我,我的名字是什么吗?'} ]

response = get_completion_from_messages(messages, temperature=1)

print(response)输出:

抱歉,我不知道您的名字,因为我们是虚拟的聊天机器人和现实生活中的人类在不同的世界中。如上所见,模型实际上并不知道我的名字。

因此,每次与语言模型的交互都是一个独立的交互,这意味着我们必须提供所有相关的消息,以便模型在当前对话中进行引用。如果想让模型引用或 “记住” 对话的早期部分,则必须在模型的输入中提供早期的交流。我们将其称为上下文。让我们试试。

输入:

messages = [

{'role':'system', 'content':'你是个友好的聊天机器人。'},

{'role':'user', 'content':'Hi, 我是Isa'},

{'role':'assistant', 'content': "Hi Isa! 很高兴认识你。今天有什么可以帮到你的吗?"},

{'role':'user', 'content':'是的,你可以提醒我, 我的名字是什么?'} ]

response = get_completion_from_messages(messages, temperature=1)

print(response)输出:

当然可以!您的名字是Isa。现在我们已经给模型提供了上下文,也就是之前的对话中提到的我的名字,然后我们会问同样的问题,也就是我的名字是什么。因为模型有了需要的全部上下文,所以它能够做出回应,就像我们在输入的消息列表中看到的一样。

订餐机器人

现在,我们构建一个 “订餐机器人”,我们需要它自动收集用户信息,接受比萨饼店的订单。

下面这个函数将收集我们的用户消息,以便我们可以避免手动输入,就像我们在刚刚上面做的那样。这个函数将从我们下面构建的用户界面中收集提示,然后将其附加到一个名为上下文的列表中,并在每次调用模型时使用该上下文。模型的响应也会被添加到上下文中,所以模型消息和用户消息都被添加到上下文中,因此上下文逐渐变长。这样,模型就有了需要的信息来确定下一步要做什么。

函数:

def collect_messages(_):

prompt = inp.value_input

inp.value = ''

context.append({'role':'user', 'content':f"{prompt}"})

response = get_completion_from_messages(context)

context.append({'role':'assistant', 'content':f"{response}"})

panels.append(

pn.Row('User:', pn.pane.Markdown(prompt, width=600)))

panels.append(

pn.Row('Assistant:', pn.pane.Markdown(response, width=600, style={'background-color': '#F6F6F6'})))

return pn.Column(*panels)现在,我们将设置并运行这个 UI 来显示订单机器人。初始的上下文包含了包含菜单的系统消息。请注意,上下文会随着时间的推移而不断增长。

安装第三方库:

pip install panel文本:

# 中文

import panel as pn # GUI

pn.extension()

panels = [] # collect display

context = [{'role':'system', 'content':"""

你是订餐机器人,为披萨餐厅自动收集订单信息。

你要首先问候顾客。然后等待用户回复收集订单信息。收集完信息需确认顾客是否还需要添加其他内容。

最后需要询问是否自取或外送,如果是外送,你要询问地址。

最后告诉顾客订单总金额,并送上祝福。

请确保明确所有选项、附加项和尺寸,以便从菜单中识别出该项唯一的内容。

你的回应应该以简短、非常随意和友好的风格呈现。

菜单包括:

菜品:

意式辣香肠披萨(大、中、小) 12.95、10.00、7.00

芝士披萨(大、中、小) 10.95、9.25、6.50

茄子披萨(大、中、小) 11.95、9.75、6.75

薯条(大、小) 4.50、3.50

希腊沙拉 7.25

配料:

奶酪 2.00

蘑菇 1.50

香肠 3.00

加拿大熏肉 3.50

AI酱 1.50

辣椒 1.00

饮料:

可乐(大、中、小) 3.00、2.00、1.00

雪碧(大、中、小) 3.00、2.00、1.00

瓶装水 5.00

"""} ] # accumulate messages

inp = pn.widgets.TextInput(value="Hi", placeholder='Enter text here…')

button_conversation = pn.widgets.Button(name="Chat!")

interactive_conversation = pn.bind(collect_messages, button_conversation)

dashboard = pn.Column(

inp,

pn.Row(button_conversation),

pn.panel(interactive_conversation, loading_indicator=True, height=300),

)输入:

messages = context.copy()

messages.append(

{'role':'system', 'content':'创建上一个食品订单的 json 摘要。\

逐项列出每件商品的价格,字段应该是 1) 披萨,包括大小 2) 配料列表 3) 饮料列表,包括大小 4) 配菜列表包括大小 5) 总价'},

)

response = get_completion_from_messages(messages, temperature=0)

print(response)输出:

{

"order": {

"pizza": {

"type": "芝士披萨",

"size": "大",

"price": 10.95

},

"toppings": [

{

"name": "蘑菇",

"price": 1.5

}

],

"drinks": [

{

"name": "雪碧",

"size": "大",

"price": 3

},

{

"name": "雪碧",

"size": "大",

...

"total_price": 18.45

}

}现在,我们已经建立了自己的订餐聊天机器人。请随意自定义并修改系统消息,以更改聊天机器人的行为,并使其扮演不同的角色和拥有不同的知识。

4. 总结

恭喜你完成了这门短期课程。

总的来说,在这门课程中,我们学习了关于 prompt 的两个关键原则:

-

- 编写清晰具体的指令;

-

- 如果适当的话,给模型一些思考时间。

你还学习了迭代式 prompt 开发的方法,并了解了如何找到适合你应用程序的 prompt 的过程是非常关键的。

我们还介绍了许多大型语言模型的功能,包括摘要、推断、转换和扩展。你还学会了如何构建自定义聊天机器人。在这门短期课程中,你学到了很多,希望你喜欢这些学习材料。

我们希望你能想出一些应用程序的想法,并尝试自己构建它们。请尝试一下并让我们知道你的想法。你可以从一个非常小的项目开始,也许它具有一定的实用价值,也可能完全没有实用价值,只是一些有趣好玩儿的东西。请利用你第一个项目的学习经验来构建更好的第二个项目,甚至更好的第三个项目等。或者,如果你已经有一个更大的项目想法,那就去做吧。

大型语言模型非常强大,作为提醒,我们希望大家负责任地使用它们,请仅构建对他人有积极影响的东西。在这个时代,构建人工智能系统的人可以对他人产生巨大的影响。因此必须负责任地使用这些工具。

现在,基于大型语言模型构建应用程序是一个非常令人兴奋和不断发展的领域。现在你已经完成了这门课程,我们认为你现在拥有了丰富的知识,可以帮助你构建其他人今天不知道如何构建的东西。因此,我希望你也能帮助我们传播并鼓励其他人也参加这门课程。

最后,希望你在完成这门课程时感到愉快,感谢你完成了这门课程。我们期待听到你构建的惊人之作。